8 Minuten

Etwas zum ästhetischen Hintergrund

Zunächst möchte ich auf den Reiz eingehen, den die Transformationen der Gestaltungen sowie das Arbeiten mit Schleifen in diesem Zusammenhang für mich darstellen: Die Harmonie von Entwicklung und Variation innerhalb eines prozeduralen Zeitvorgangs, die schließlich zu neuen Erscheinungen führt und dadurch – über ein zeitliches Kontinuum hinweg – zur Zuspitzung der Wahrnehmung beiträgt, verleiht den mithilfe von Schleifen erschaffenen Strukturen einen markanten Charakter. Dass bei Schleifen das Einführen und Einleiten des Unerwarteten in die laufenden Formen und Prozesse auf ein Minimum reduziert werden kann, ohne den ästhetischen Reiz zu beeinträchtigen, wussten z.B. die Minimal-Künstler sehr effektiv zu nutzen.

Das Entstehen eines diversen Ganzen aus demselben Kern – vergleichbar mit der biologischen Evolution, bei der sich fortlaufendes Leben durch graduelle Veränderungen entwickelt und Neues aus der Variation ursprünglicher Formen entsteht – erscheint mir im Kontext künstlerischen Schaffens gleichermaßen reizvoll wie utopisch. Denn ein beharrliches Festhalten an einer von Schleifen diktierten Ästhetik kann die Wahrnehmungsbereitschaft derart verblassen lassen, wie sie zugespitzt wurde.

Meine Suche nach Methoden und Formen des Umgangs mit Schleifen und deren Generierung, um Variationen, Übergänge und Transformationen zwischen klanglichen Zusammenhängen mit der Starrheit von Strukturen zu vereinen, begann zunächst in meinen früheren instrumentalen Werken auf naive Art – zumeist rein empirisch und ohne theoretischen oder systematischen Ansatz.

Diese frühen, rein empirisch durchgeführten musikalischen Transformationen mangelten an einer universellen, besetzungsagnostischen Lösungsstrategie, die es ermöglicht hätte, die Methoden nicht nur in der Instrumentalmusik, sondern auch in der algorithmischen elektronischen Musik anzuwenden. Meine erste Reaktion bestand darin, dieselben empirisch erarbeiteten manuellen Prozesse für die elektronische Musik zu programmieren, bis mir die konzeptionellen Parallelen zwischen meinem Ziel, meiner Methodik und denen des „dynamischen Programmierens“, insbesondere des Dynamic Time Warping, auffielen. Bevor ich jedoch auf eine Zusammenfassung dieses Algorithmus eingehe, möchte ich zunächst die Problematik musikalischer Übergänge näher beschreiben.

Die Problematik des Übergangs und der Ähnlichkeitssuche

Einen Übergang zu erstellen bedeutet, eine Brücke zwischen zwei Seiten innerhalb einer bestimmten Zeitspanne zu schlagen. In diesem Zusammenhang möchte ich mich vor allem auf Übergänge zwischen Klangsequenzen fokussieren. Konkret wird sich mein Artikel mit der Transition der klanglichen Merkmale einer zeitlich geordneten Klangfolge befassen.

Dabei betrachte ich einen Klang als eine multidimensionale Entität, wobei jede Dimension eine unterschiedliche Eigenschaft des einzelnen Klangs darstellt: Dauer, Tonhöhe, Intensität und geografische Lokalisation sind einige allgemein bekannte Dimensionen. Die Liste kann jedoch bei digital synthetisierten Klängen um alle für die Synthese relevanten Eigenschaften erweitert werden. Im einfachsten Fall handelt es sich um eine eindimensional definierte Entität – beispielsweise, wenn wir für die Transition nur die Dauer der Klänge betrachten. Trivialerweise würde man hier durch eine Interpolation (im einfachsten Fall bei gleicher Länge beider Sequenzen) zwischen den Dauern der einzelnen Klänge mit demselben Index einen Übergang erstellen.

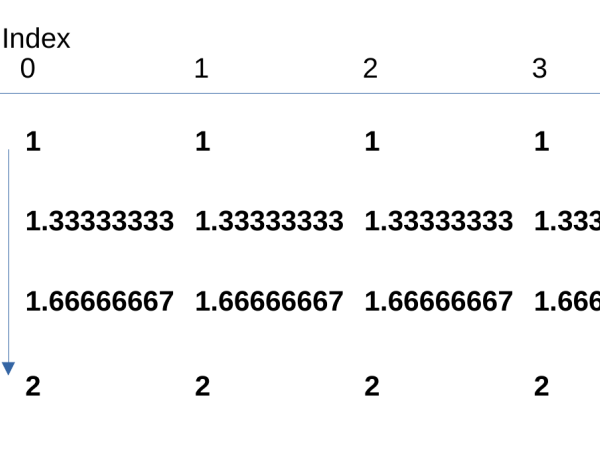

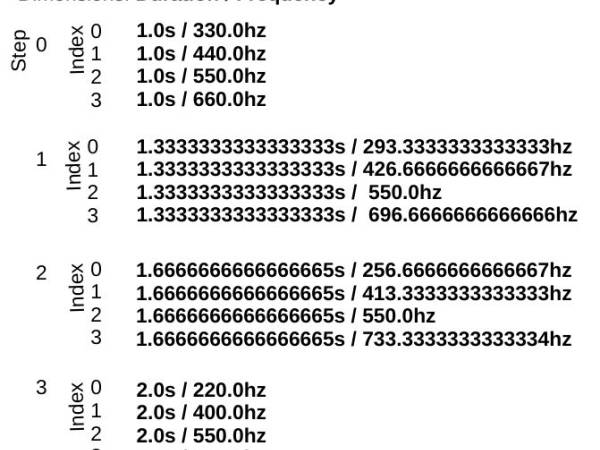

Ein solcher Fall ist unten dargestellt, wobei ein linearer Übergang zwischen den 1-dimensionalen Elementen zweier 4-elementiger Sequenzen über 4 Schritte erstellt wurde. Dies ist eine Transition von Dauern (z.B. in Sekunden berechnet) [1, 1, 1, 1] zu [2, 2, 2, 2], die ein Ritardando darstellt (die Frequenzen bleiben hier konstant und wurden manuell auf 330, 440, 550, 660 Hz festgelegt):

Immer noch anschaulich ist es, wenn wir bei gleicher Sequenzlänge die Anzahl der Dimensionen pro Klang von 1 auf 2 erhöhen. Im folgenden Beispiel beziehe ich die Frequenzen in den Übergangsprozess ein und erweitere damit die Dimensionen jeder Entität auf zwei: Dauer und Frequenz.

Die Initialsequenz besteht hier aus Tönen mit den Dauern [1, 1, 1, 1] und den Frequenzen [330, 440, 550, 660] Hertz, während die Terminalsequenz Töne mit den Dauern [2, 2, 2, 2] und den Frequenzen [220, 400, 550, 770] Hertz umfasst. Die Zuordnung der Klangelemente zueinander erfolgt hier – wie im vorherigen Beispiel – unkompliziert: von jedem Index aus der Sequenz 1 zum selben Index in Sequenz 2 über die angegebene Anzahl von Schritten (hier 4):

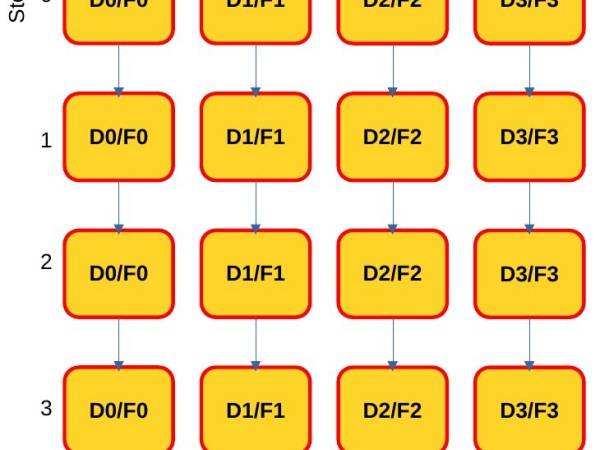

Der Grund für diese einfache Zuordnung der Elemente liegt in den marginalen Änderungen der Dimensionen zwischen Start- und Zielsequenz, die die Verwandtschaft der Elemente zueinander nicht beeinträchtigen. Die Sequenzen der 4-schrittigen Transition lassen sich daher wie folgt darstellen:

Dies sind Beispiele, bei denen man meinen könnte, eine einfache Index-basierte Interpolation zwischen den Sequenzen sei ausreichend – und in diesen konkreten Fällen trifft das auch zu! Sobald jedoch die Anzahl der Klänge in den Sequenzen variiert oder die Unterschiede der jeweiligen Dimensionen steigen, reicht diese Methode nicht mehr aus. Es sind weitere Maßnahmen erforderlich, um die Assoziation der Klänge zwischen den Sequenzen zu bestimmen (sofern diese Assoziation nicht zufällig erfolgen soll).

Hier kommt die Berechnung von Ähnlichkeiten zwischen den Klängen (betrachtet als n-dimensionale Datenpunkte) ins Spiel. Mithilfe von Dynamic Time Warping können wir anhand der euklidischen Distanz zwischen den Dimensionen (der einfachsten und geläufigsten Abstandsmetrik) eine optimale Zuordnung zwischen den Elementen ermitteln – selbst bei ungleichförmigen Sequenzverläufen.

Ausgehend von der Berechnung der Distanzen zwischen den Klangdimensionen mittels der euklidischen Abstandsmetrik gilt: Je näher die Werte der jeweiligen Dimensionen beieinander liegen, desto ähnlicher sind die Klänge zueinander.

Was ist Dynamic Time Warping?

Im folgenden Teil beschreibe ich zusammenfassend den Dynamic-Time-Warping-Algorithmus. Ausführlichere Beschreibungen können dem Paper von Hiroaki Sakoe und Seibi Chiba (Dynamic Programming Algorithm Optimization for Spoken Word Recognition, IEEE Transactions on Acoustics, Speech and Signal Processing, Vol. ASSP-26, No.1, February 1978) oder dem Internet entnommen werden.

Das Optimierungsproblem

Das Dynamic Time Warping (DTW) ist eine Methode zur Messung der Ähnlichkeit zwischen zwei zeitlichen Sequenzen, die sich in ihrer Geschwindigkeit unterscheiden können und deren Elemente sich im selben N-dimensionalen Raum befinden. Es wird häufig in Bereichen wie Spracherkennung, Gestenerkennung und Zeitreihenanalyse eingesetzt. Das Ziel von DTW ist es, eine optimale Ausrichtung zwischen zwei Sequenzen zu finden, indem die Zeitachse der Sequenzen so verzerrt wird, dass der Abstand zwischen ihnen minimiert wird.

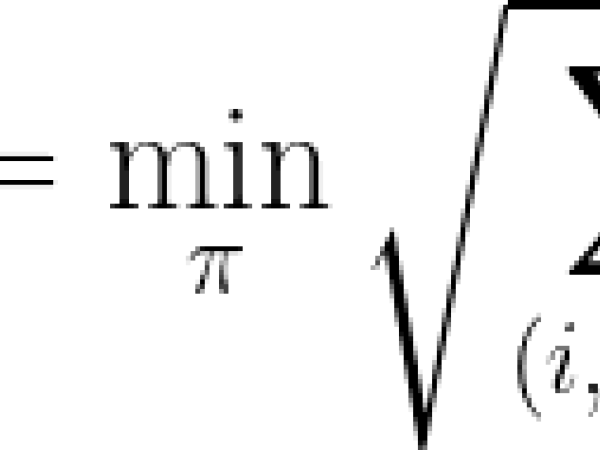

Als Beispiel seien die beiden Zeitreihen x = (x0, ....,xn-1) und y = (y0, ....,ym-1) mit den jeweiligen Längen n und m gegeben. Das DTW zwischen den Sequenzen x und y wird formuliert als:

wobei der Ausrichtungspfad (Alignment-Path) π = [π0, ...,πk] ist mit den folgenden Eigenschaften:

1. Es ist eine Liste mit Index-Paaren πk = (ik, jk) wobei 0 ≤ ik < n und 0 ≤ jk < m

2. π0 = (0, 0) und πk = (n-1, m-1)

3. Wo k > 0, πk = (ik, jk) steht zu folgender Beziehung zu πk-1 = (ik-1, jk-1):

- ik-1 ≤ ik ≤ ik-1 + 1

- jk-1 ≤ jk ≤ jk-1 + 1

Der Ausrichtungspfad ist eine zeitliche Ausrichtung der beiden Zeitreihen x und y, sodass deren Abstand zueinander (oft der euklidische Abstand) am geringsten ist.

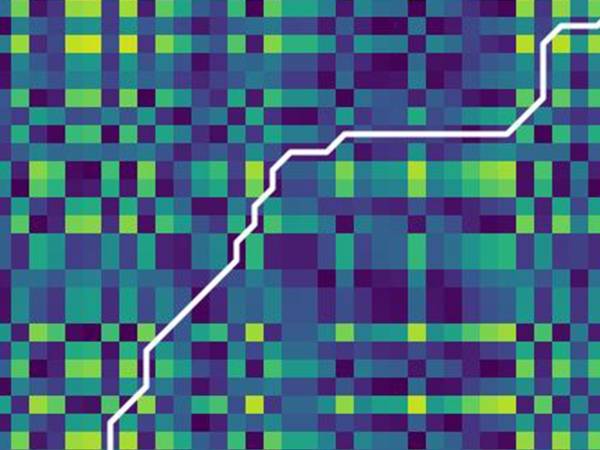

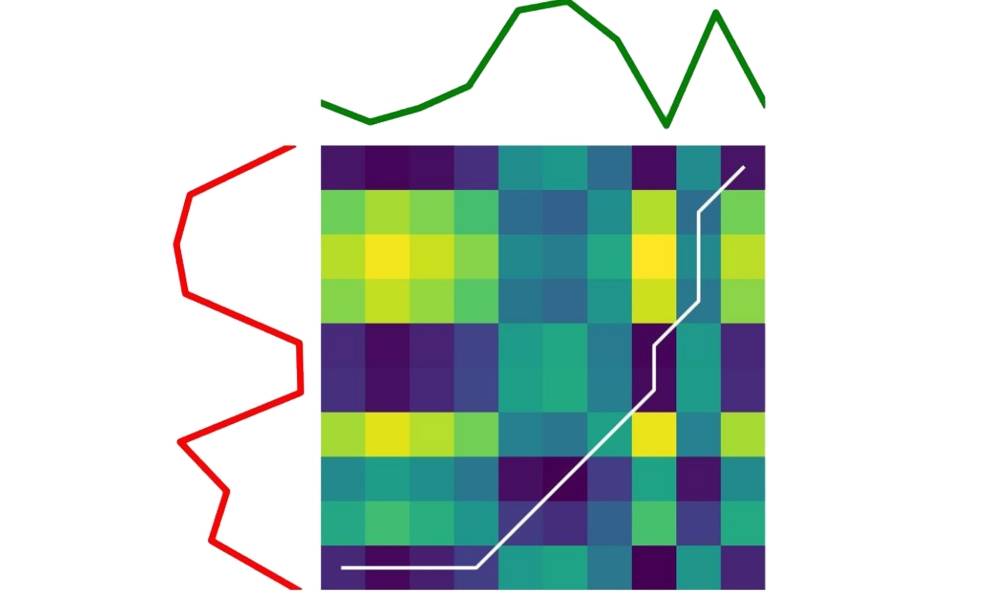

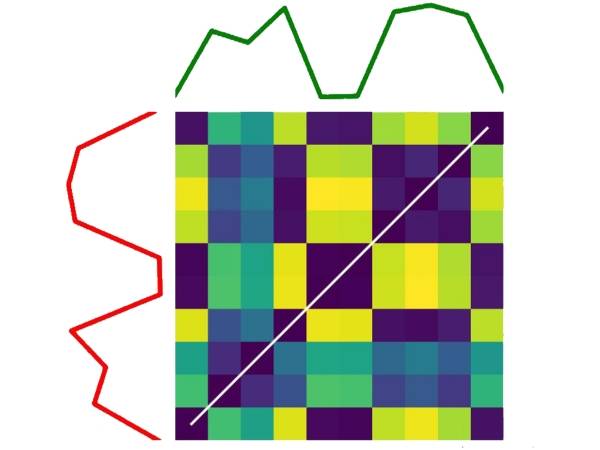

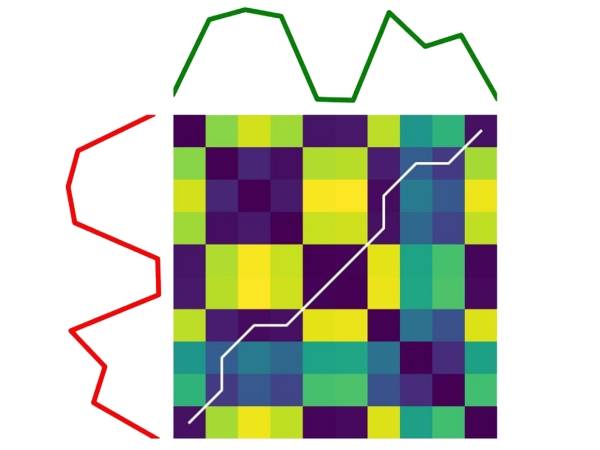

Ein solcher Ausrichtungspfad ist in den folgenden Grafiken für jeweils zwei Zeitreihen mit derselben Größe von 10 Elementen (y-Achse: rote Linie, x-Achse: grüne Linie) mit der weißen Linie dargestellt. Die weiße Linie zeichnet den optimalen (kürzesten) Weg zwischen den beiden Reihen auf einer 10x10-Abstandsmatrix, die hier als eine “Heatmap“ dargestellt ist. Auf der Karte gilt: Je "gelber" der mögliche Schritt (die einzelnen Quadrate), desto größer der Abstand der jeweiligen Elemente der x- und y-Sequenzen. Der optimale Weg verläuft vom ersten Elementvergleich (unten links, mit den Indizien 0, 0) zum letzten (oben rechts, mit den Indizien 9, 9) durch die "kältesten" Felder (geringster Abstand):

Der Ausrichtungspfad zweier identischer Sequenzen verläuft diagonal und gerade:

Die Kostenmatrix und der optimale Ausrichtungspfad (weiße Linie) für eine einzelne Zeitreihe.

Der Ausrichtungspfad einer Sequenz mit deren eigener Rückwärtsform verläuft als symmetrische diagonale Linie:

Die Kostenmatrix und der optimale Ausrichtungspfad (weiße Linie) für eine Zeitreihe (rot) und ihre umgekehrte Form (grün).

Der Ausrichtungspfad zweier unterschiedlicher Sequenzen:

Die Kostenmatrix und der optimale Ausrichtungspfad (weiße Linie) für zwei verschiedene Zeitreihen.

Klangbeispiele

Man könnte den Ausrichtungspfad bei DTW definieren als das Ergebnis der Suche nach dem optimalen nächstgelegenen Weg zwischen zwei Zeitreihen potenziell unterschiedlicher Dauern.

Durch die Identifizierung der ähnlichsten Datenpunkt-Paare beider Sequenzen ermöglicht DTW eine effiziente Überbrückung dieser Korrespondenzen und ermöglicht so das Schaffen eines nahtlosen Übergangs zwischen den Zeitreihen. Obwohl der Ausrichtungspfad in den meisten praktischen Anwendungen des DTW primär zur Berechnung eines Ähnlichkeitswertes dient (und selten direkt genutzt wird), erweist er sich aus künstlerischer Perspektive als ein nützliches Werkzeug – z.B. für die schrittweise Metamorphose von Klangfolgen.

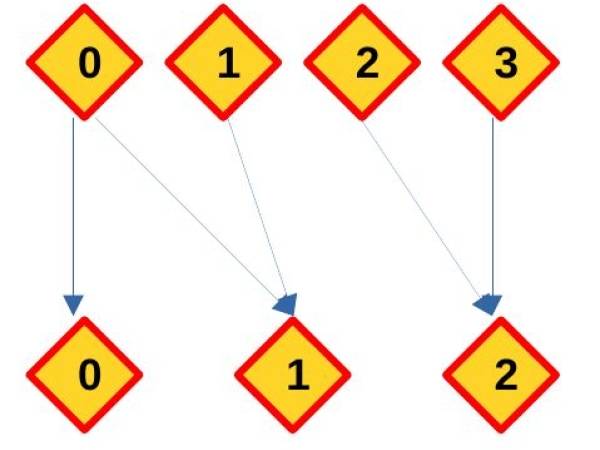

Wie im letzten Teil zur Veranschaulichung von DTW beschrieben, kann der rohe Ausrichtungspfad eine oder mehrere Zuordnungen zwischen Datenpunkten beinhalten. Ein Beispielpfad könnte folgende Form aufweisen: (0,0), (0,1), (1,1), (2,2), (3,2).

Oder in visueller Darstellung:

Hier wird der erste Datenpunkt der Ausgangssequenz beiden ersten Punkten der Zielsequenz zugeordnet, während die letzten beiden Punkte der Ausgangssequenz auf den letzten Punkt der Zielsequenz abgebildet werden. Da dieser Pfad jedoch Redundanzen enthält, die in den Originalsequenzen nicht vorhanden waren (mehrfache Verknüpfungen derselben Datenpunkte), muss er nachbearbeitet werden, um die strukturelle Integrität der Originalsequenzen zu wahren. Hierfür entscheide ich mich zwischen redundanten Verknüpfungen für diejenige mit dem höheren Ähnlichkeitswert.

Es folgen, zwei mithilfe des Ausrichtungspfades produzierte, Klangbeispiele.

Beispiel 1: Ein Übergang zwischen zwei Sequenzen:

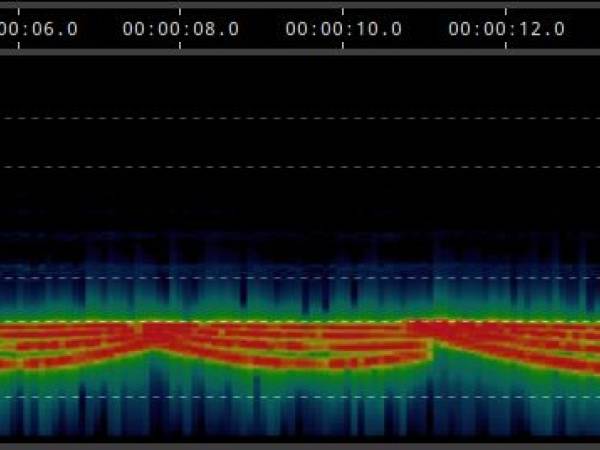

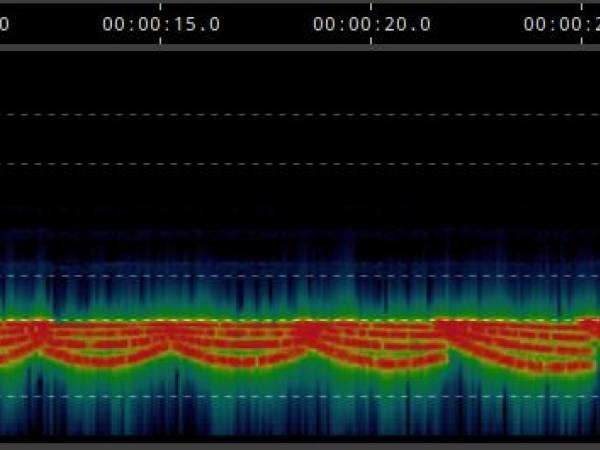

- Ausgangssequenz: Vier aufsteigende Frequenzlinien mit unterschiedlichen Startfrequenzen, aber gemeinsamer Endfrequenz.

- Zielsequenz: Die umgekehrte Ausgangssequenz – vier Frequenzlinien mit identischer Startfrequenz, die zu den ursprünglichen Startfrequenzen der Ausgangssequenz divergieren.

Definierte Parameter sind: Dauer und Frequenz der Klänge. Es ist möglich, die Anzahl der Übergangsschritte festzulegen (Start- und Endzustand inklusive). Ein 4-stufiger Übergang umfasst z.B. 1. Ausgangszustand, 2. Erster Zwischenschritt, 3. Zweiter Zwischenschritt und 4. Zielzustand.

Die unten aufgelisteten Umsetzungen demonstrieren den Übergang in 6, 12, 25 und schließlich 50 Schritten, wobei mehr Schritte langsamere Veränderungen und damit eine Glättung der Transition bedeuten:

Transition in 6 Stufen

Transition in 12 Stufen

Transition in 25 Stufen

Transition in 50 Stufen

Beispiel 2: Aneinanderreihung von Übergängen:

1. Vom Kinderlied “Hänschen klein” zu “Alle meine Entchen” in 17 Schritten:

2. Ein erweiterter Pfad integriert auch das Öffnungsthema aus Steve Reichs “Piano Phase”:

- “Hänschen klein” → “Piano Phase”-Motiv (in 20 Schritten)

- “Piano Phase” → “Alle meine Entchen” (in 15 Schritten)

Musikalischer Einsatz

Der Reiz dieser Methode liegt in ihrer Unabhängigkeit von musikalischen stilistischen Merkmalen: Der Algorithmus verarbeitet Klangfolgen unabhängig von genretypischen Besonderheiten. Dies eröffnet ein breites Experimentierfeld für “transitionale Musik”, bei der selbst stilistisch konträre Klangsequenzen ineinanderfließen können. Im folgenden Abschnitt stelle ich ein eigenes Kurzwerk vor, dessen Klangmaterialien aus mithilfe von DTW erstellten Transitionen gewonnen wurden.

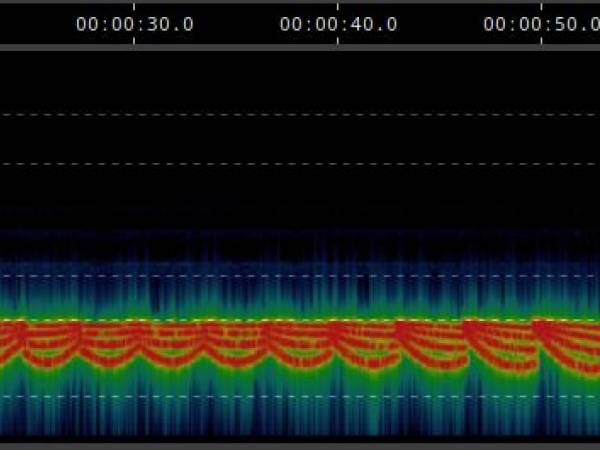

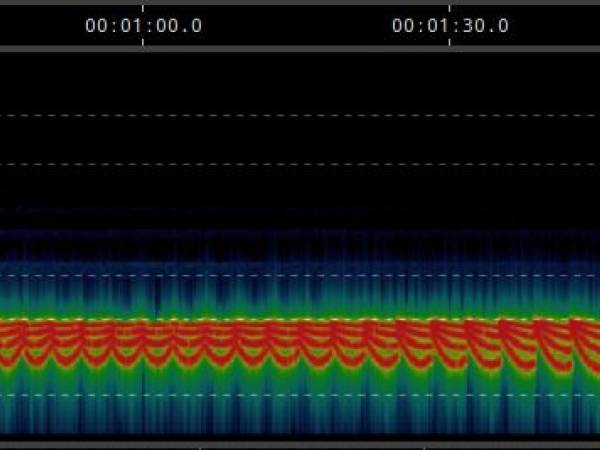

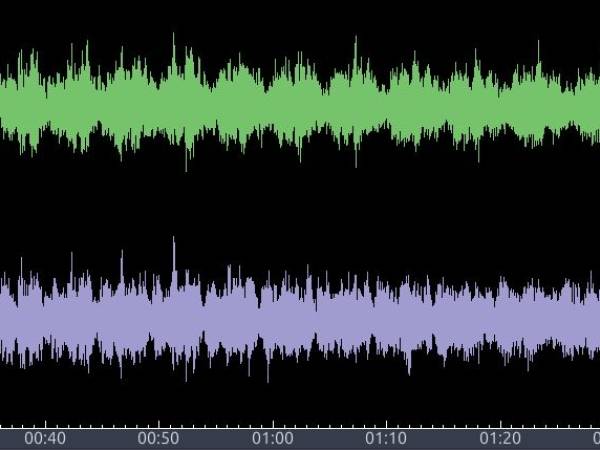

Transition Studies (2024/25, erster Satz)

“Transition Studies” ist ein vierkanaliges Werk, bestehend aus drei kurzen Stücken. Der erste 2-minütige Satz besteht aus einem einzigen durchgehenden, ununterbrochenen Übergang zwischen zwei Klanggesten, die am Anfang und am Ende des Stücks zu hören sind. Gegenstand dieses Übergangs sind in diesem Satz neben zeitlichen Variationen der beiden Anfangs- und End-Klangfolgen auch eine Modulation in der Abspielgeschwindigkeit der verwendeten Samples, sowie ein Übergang in der geographischen Ortung der Klänge (welcher Klang aus welchem Lautsprecher). Es handelt sich also um eine dreidimensionale Transition: Dauer, Modulationsfaktor und Lokalisation.

Der Satz assoziiert durch seine rohe Klangmaterialität und den rauen Formverlauf die brutalistische Architektur.

Unten ist ein Stereo-Mix dieses Satzes.

Amir Teymuri

Amir Teymuri studierte Komposition, Klavier und Musikinformatik an der Universität Teheran, der Hochschule für Musik Freiburg, der Hochschule für Musik und Darstellende Kunst Frankfurt am Main und am Institut für Musikinformatik und Musikwissenschaft der Hochschule für Musik Karlsruhe. Im Jahr 2004 wurde er bei der Ersten Nationalen Biennale für Neue Musik an der Universität Teheran ausgezeichnet. Im Jahr 2015 war er Stipendiat der Akademie der Künste (AdK Berlin) und Artist-in-Residence am Zentrum für Kunst und Urbanistik (ZK/U Berlin). Neben seiner Tätigkeit als freischaffender Komponist ist er derzeit als Dozent an der Hochschule für Musik und Theater München und am Institut für Musikinformatik in Karlsruhe tätig.

Artikelthemen

Artikelübersetzungen erfolgen maschinell und redigiert.

Amir Teymuri

Amir Teymuri